數字孿生技術作為連接物理世界與數字世界的橋梁,正深刻變革著傳統工程行業。在工程造價咨詢領域,其應用已從概念走向實踐,為提升精度、效率和決策水平開辟了新路徑。以下是數字孿生技術在工程造價咨詢業務中的十大核心應用領域:

- 全生命周期成本動態模擬與預測:通過構建與實體項目實時同步的數字孿生模型,可以在項目規劃、設計、施工、運維直至報廢的全過程中,動態模擬材料、人工、設備、能耗等成本變化,實現成本的前瞻性預測與預警,為投資決策和成本控制提供精準依據。

- 設計方案的成本實時驗證與優化:在設計階段,將不同設計方案導入數字孿生平臺,可即時測算并可視化其對應的工程量清單與造價,實現“設計-算量-計價”一體化。咨詢方能夠快速比選方案的經濟性,協同設計方優化設計,從源頭控制造價。

- 施工過程的精細化成本管控:在施工階段,數字孿生模型與現場物聯網數據(如人員、機械、材料進場)聯動,實現工程進度與成本的實時映射。可以精確追蹤分部分項工程的資源消耗與費用發生,及時發現成本超支風險點,支持動態成本核算與支付審核。

- 工程量自動計算與復核:基于高精度三維數字孿生模型,可自動、快速、準確地提取土方、混凝土、鋼結構等工程量,極大減少人工算量誤差與重復勞動。模型變更后,工程量能自動更新,為編制和審核工程量清單提供可靠基礎。

- 供應鏈與采購成本可視化分析:將主要建筑材料、設備的供應鏈數據(價格、庫存、物流)集成到孿生環境中,可模擬不同采購策略、運輸路徑對項目總成本的影響,輔助制定最優采購計劃,應對市場價格波動。

- 變更管理與索賠分析:當發生工程變更時,數字孿生模型能清晰記錄變更前后的狀態,精確量化變更引起的工程量與造價增減,為變更估價和潛在的工期/費用索賠提供客觀、可追溯的數據證據,減少爭議。

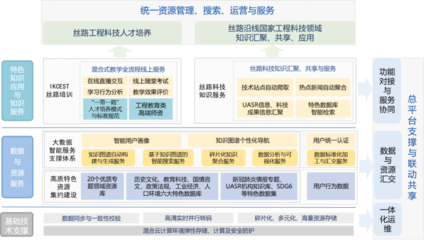

- 協同造價審查與審計:項目各參與方(業主、咨詢、施工、監理)可在統一的數字孿生平臺上,基于同一數據源進行造價文件的在線審查、批注與確認,提高審查效率和透明度。審計部門亦可利用模型追溯歷史數據,強化審計監督。

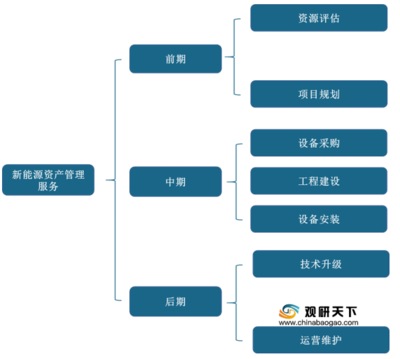

- 資產運維成本預測與優化:在運維階段,數字孿生模型整合設備運行數據、能耗數據、維護歷史等,可預測未來維修、更換、能源消耗等長期持有成本,為制定經濟合理的運維預算、設施更新改造計劃提供支持。

- 投資風險評估與敏感性分析:結合數字孿生模型與外部經濟環境數據(如利率、通脹率),構建成本風險模型,模擬多種市場情景下項目造價的可能波動范圍,量化投資風險,并進行關鍵成本影響因素的敏感性分析。

- 知識沉淀與造價數據庫構建:每個項目的數字孿生模型及其關聯的成本數據,構成結構化的項目造價案例庫。通過積累和分析多項目數據,可以提煉不同工程類型、不同地區的造價指標、工效參數,形成企業寶貴的知識資產,提升未來項目的估算精度和咨詢服務水平。

****:

數字孿生技術正將工程造價咨詢從傳統的靜態、分段、事后核算模式,推向動態、全周期、前瞻性管理的嶄新階段。這十大應用領域相互關聯、層層遞進,共同構建起數據驅動、智能決策的新型造價咨詢服務體系。擁抱這一變革,造價咨詢企業不僅能提升自身核心競爭力和價值,更能為工程建設全產業鏈的降本增效與高質量發展提供關鍵支撐。